29 Abr 106 Aniversario de Claude Shannon

29/04/2022

Claude Shannon publicó en 1948, a los 32 años, el artículo ‘una teoría matemática de la comunicación’ introduciendo al mundo el concepto de ‘entropía de la información’ y su actualmente famosa formulación matemática H=-ƩP(x)logP(x), lo que significó la invención de la Teoría de la Información, y el reconocimiento mundial de Claude como su padre.

Hoy queremos compartir una de las lecciones de Shannon a través de su proceso de focalización en solucionar un problema fundamental: la comunicación confiable a través de un canal no fiable. Al centrarse en la solución de esta necesidad, Shannon terminó desarrollando su Teoría de la Información.

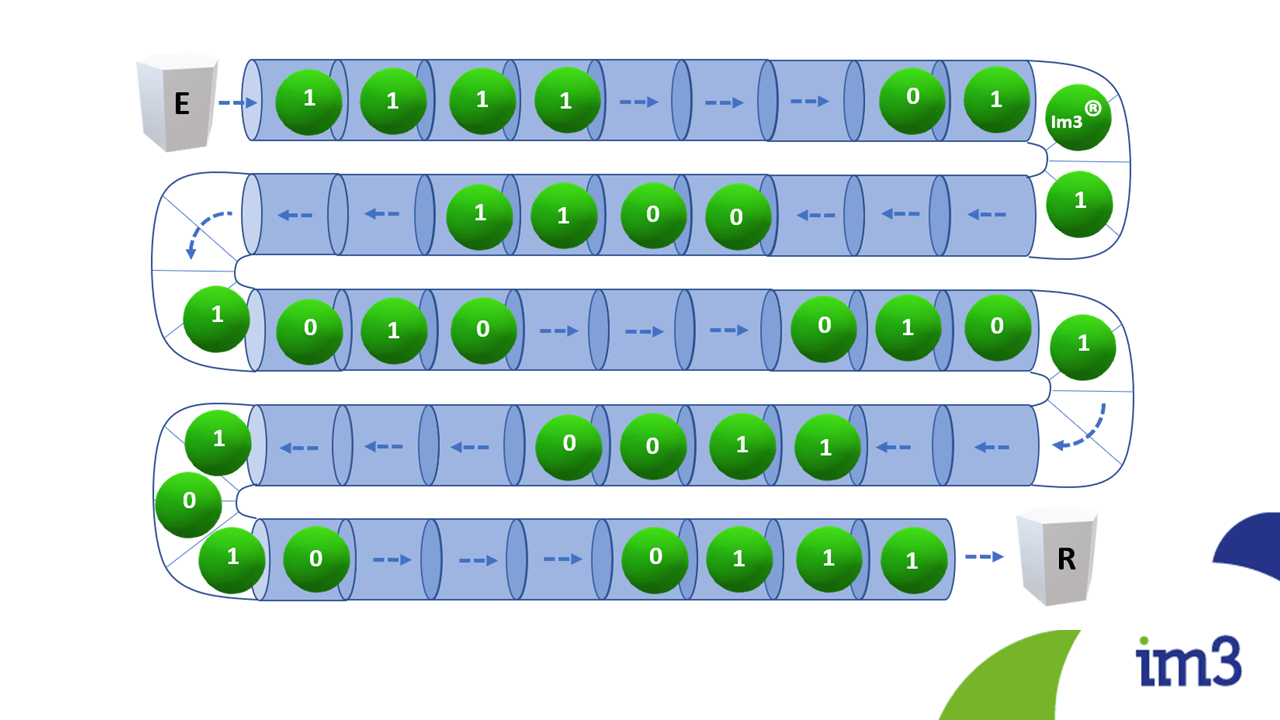

Cuando transmitimos información a través de un canal, la señal recibida en la salida es la superposición de la señal transmitida más el ruido. Gracias a la Teoría de la Información y su formulación matemática, podemos llegar a un nivel de error tan reducido como queramos, añadiendo redundancia en la transmisión incorporando sistemas de codificación en el envío y decodificación en la recepción.

Al crear de una forma tan elegante la Teoría de la Información sobre la que se asientan las bases de las ciencias de las comunicaciones y la computación, Shannon nos muestra la importancia de plantear buenas preguntas, como base fundamental para la obtención de respuestas increíbles.

En Im3 queremos seguir el ejemplo de Shannon por lo que nos planteamos desafíos para dar respuestas a la ingeniería del futuro